自然语言处理(NLP)是人工智能皇冠上的明珠,而预训练技术则是近年来驱动这颗明珠璀璨夺目的核心引擎。从早期的静态词向量到如今千亿参数的通用大模型,NLP预训练技术的发展历程,不仅深刻重塑了技术范式,也为包括北京在内的全球软件技术开发领域带来了前所未有的机遇与挑战。

一、NLP预训练技术的演进脉络

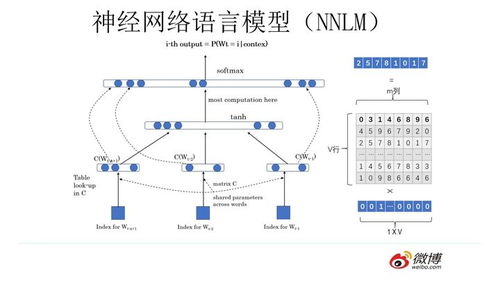

预训练技术的发展大致可分为三个阶段。首先是静态词向量时代(如Word2Vec, GloVe),其核心思想是“一词一义”,通过无监督学习为每个词赋予一个固定的向量表示,初步解决了词语的分布式表示问题,为后续研究奠定了基础。

其次是上下文感知的预训练模型时代,以ELMo、GPT和BERT的诞生为标志。这一阶段的突破在于模型能够根据上下文动态生成词语的表示,真正理解了“一词多义”。特别是谷歌提出的BERT(双向Transformer编码器),通过“掩码语言模型”和“下一句预测”两大预训练任务,在多项NLP基准测试中取得突破性成绩,确立了“预训练+微调”的主流范式。此后,模型规模进入快速扩张期,GPT-3凭借1750亿参数和强大的上下文学习能力,展示了预训练模型向通用人工智能(AGI)迈进的潜力。

当前,我们正处在大规模多模态与高效适配时代。模型不仅规模更大(如万亿参数的混合专家模型),其能力边界也从纯文本扩展至文本、图像、语音的融合理解与生成(如DALL-E, GPT-4)。面对大模型高昂的训练与部署成本,研究者们聚焦于模型的高效微调(如LoRA, Prefix-Tuning)、知识编辑、推理优化等“大模型应用工程”技术,旨在让强大的预训练能力更普惠、更易用。

二、北京软件技术开发的融合实践与产业赋能

作为中国的科技创新中心,北京拥有密集的高校、科研院所和顶尖科技企业,在NLP预训练技术的研发与应用落地上处于全国乃至全球领先地位。

- 基础研究与开源贡献:北京的多家顶尖机构是预训练技术的重要策源地。例如,清华大学、北京大学、中国科学院等在模型架构创新、高效训练算法、中文理解评估基准等方面贡献卓著。智源研究院发布的“悟道”大模型系列,百度持续迭代的“文心”大模型,都体现了北京在通用大模型基础研究方面的深厚实力。众多团队积极开源模型、工具与数据集,繁荣了中文NLP开源生态。

- 产业应用深度融合:北京的软件技术开发将预训练模型的能力深度融入各行各业。

- 智能信息服务:在搜索引擎(百度)、内容推荐(字节跳动)、信息流(快手)等领域,利用预训练模型实现更精准的语义理解、用户意图识别和内容生成,极大提升了用户体验和平台效率。

- 企业级服务与办公:通过将大模型能力API化或内嵌至办公软件(如金山办公)、客服系统、智能文档处理平台,为企业提供智能摘要、合同审核、代码生成与补全等能力,推动企业数字化、智能化转型。

- 垂直行业解决方案:在金融、法律、医疗、教育等专业领域,北京的科技公司与行业伙伴合作,基于通用大模型进行领域知识增强与精调,开发出智能投研助手、法律文书分析、辅助诊疗报告生成、个性化学习伙伴等专业工具,创造了显著的社会与经济价值。

- 开发范式的转变与挑战:预训练技术的普及也改变了北京软件开发的范式。传统“从零开始”的特征工程模式,正迅速转向以“大模型为基座”的提示工程、微调和应用开发。这要求开发者不仅需要掌握软件工程技能,更需理解大模型原理、掌握新型交互范式(如Chain-of-Thought)和评估方法。如何保障模型的可控性、安全性、公平性,以及应对算力成本、数据隐私等挑战,也是北京产业界与学术界共同攻坚的方向。

结论

NLP预训练技术的发展,是一条从“表示学习”到“理解与生成”,再到“创造与协同”的跃迁之路。它已不再是实验室中的前沿课题,而是成为了驱动新一轮软件技术革命的基础设施。北京凭借其独特的创新生态,正积极地将这股技术浪潮转化为产业升级的强大动能。随着技术的持续演进,预训练模型必将更深层次地与北京乃至全国的软件技术开发融合,催生出更多颠覆性应用,赋能千行百业,构筑智能时代的新优势。